Tự chữa bệnh theo ChatGPT: Canh bạc với sức khỏe

Việc coi ChatGPT như một "bác sĩ ảo" để tự kê đơn đang trở thành trào lưu đáng lo ngại. Đằng sau sự tiện lợi là những hiểm họa khó lường, thậm chí đe dọa đến tính mạng người dùng.

Hiểm họa từ những "đơn thuốc" thiếu cơ sở lâm sàng

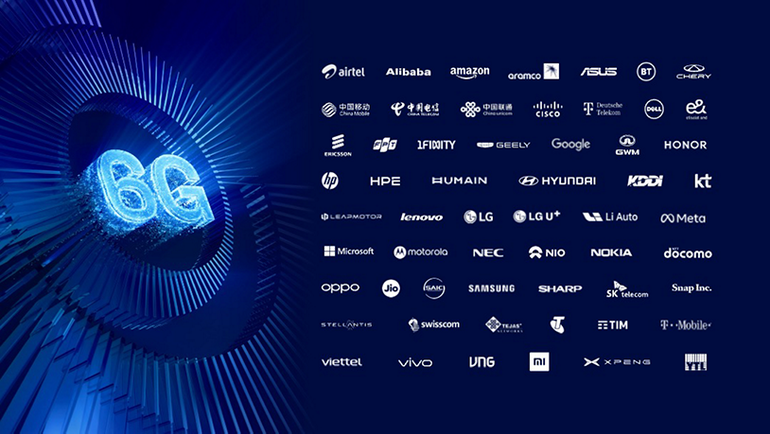

Hình ảnh một người dùng đưa ra vài triệu chứng như ho, sổ mũi, nghẹt mũi và nhận lại từ ChatGPT một danh sách thuốc, trong đó có cả Corticoid - một loại thuốc chống viêm mạnh cần có chỉ định của bác sĩ, đã khiến giới chuyên môn thực sự lo ngại.

|

| Hình ảnh đơn thuốc do ChatGPT tạo ra đang được chia sẻ trên mạng xã hội. |

Chia sẻ về vấn đề này, bác sĩ Đoàn Dư Mạnh, thành viên Hội Bệnh mạch máu Việt Nam, cảnh báo: “Người dùng có thể thấy triệu chứng thuyên giảm sau khi uống, nhưng nếu nguyên nhân là do vi khuẩn hoặc virus khác mà không được chẩn đoán chính xác, việc không dùng kháng sinh hoặc dùng sai thuốc có thể khiến bệnh tiến triển nặng, dẫn đến viêm phổi, viêm hô hấp nặng”.

Nguy cơ lớn nhất nằm ở chỗ AI hoàn toàn không thể biết được tình trạng sức khỏe tổng thể của người dùng. Chatbot không có khả năng hỏi và đánh giá bệnh nhân có bệnh nền về gan, thận, tiểu đường, có đang mang thai hay tiền sử dị ứng thuốc hay không.

“Hãy tưởng tượng một bệnh nhân đang suy gan, suy thận mà lại dùng thuốc chống viêm hoặc kháng histamin mạnh theo gợi ý của AI, nguy cơ suy đa tạng, thậm chí tử vong là hoàn toàn có thể xảy ra,” bác sĩ Mạnh nhấn mạnh.

Hơn nữa, nhiều phản ứng của cơ thể như hắt hơi, chảy nước mũi vốn là cơ chế tự vệ sinh lý giúp tống vi khuẩn ra ngoài. Việc lạm dụng thuốc ức chế các phản ứng này có thể vô tình tạo điều kiện cho mầm bệnh sinh sôi mạnh hơn, khiến bệnh nặng thêm sau khi triệu chứng ban đầu tạm lui.

Bác sĩ Mạnh cũng khẳng định, việc nhà thuốc bán thuốc kê đơn theo một "đơn AI" là hành vi vi phạm quy định của Bộ Y tế. "Không bác sĩ nào kê đơn mà không biết tuổi, cân nặng, tiền sử bệnh của bệnh nhân. AI chỉ dựa vào vài dòng mô tả, làm sao có thể đảm bảo an toàn?", ông đặt vấn đề.

Những ca ngộ độc và lời cảnh tỉnh từ thực tế

Việc mù quáng tin vào "bác sĩ ảo" đã dẫn đến những hậu quả nghiêm trọng trên thế giới. Điển hình là trường hợp một người đàn ông 60 tuổi ở Mỹ suýt mất mạng sau khi làm theo "lời khuyên dinh dưỡng" từ ChatGPT.

Khi hỏi AI về chất thay thế muối ăn (natri clorua), ông đã được gợi ý dùng natri bromide. Đây là một hợp chất từng được sử dụng trong y học đầu thế kỷ 20 nhưng ngày nay đã bị loại bỏ do có độc tính cao. Suốt ba tháng, người đàn ông này đã vô tư dùng hóa chất độc hại thay cho muối ăn sau khi đặt mua qua mạng.

|

| Việc mù quáng tin vào "bác sĩ ảo" có thể dẫn đến những hậu quả nghiêm trọng. |

Hậu quả là ông bị ngộ độc bromide nặng với các triệu chứng lú lẫn, ảo giác, hoang tưởng, nói líu và có nguy cơ hôn mê. Đây là một lời cảnh tỉnh đắt giá về việc tự ý chẩn đoán và điều trị theo những thông tin chưa được kiểm chứng từ AI.

Rủi ro kép: Từ sức khỏe đến bảo mật thông tin cá nhân

Không chỉ dừng lại ở nguy cơ sức khỏe, việc chia sẻ thông tin bệnh lý cho AI còn tiềm ẩn rủi ro về bảo mật. Anh Nguyễn Ngọc Tuyên, chuyên gia AI tại Công ty Cổ phần Công nghệ Sotatek, cho biết các công cụ như ChatGPT hoạt động dựa trên dữ liệu ngôn ngữ khổng lồ từ internet, chúng không có khả năng phân tích lâm sàng hay cảm nhận tình trạng sức khỏe con người.

“Chúng ta dễ bị đánh lừa bởi những câu trả lời có vẻ logic, đầy đủ, nhưng thực chất không hề có giá trị chẩn đoán. Nguy hiểm hơn, việc nhập các dữ liệu nhạy cảm như triệu chứng, kết quả xét nghiệm, hồ sơ y tế lên các nền tảng này là một hành vi rủi ro. Nếu dữ liệu bị rò rỉ, người dùng có thể đối mặt với việc bị lợi dụng thông tin, xâm phạm đời tư, thậm chí là đánh cắp danh tính để lừa đảo,” anh Tuyên cảnh báo.

Vì sao "bác sĩ AI" hấp dẫn và đâu là giới hạn an toàn?

Vậy tại sao nhiều người, đặc biệt là người trẻ, lại chọn hỏi AI thay vì đến gặp bác sĩ? Lý do chính đến từ sự tiện lợi, nhanh chóng và tâm lý e ngại. "Hỏi ChatGPT 3 giây là có câu trả lời, không cần chờ đợi, và quan trọng là nó không bao giờ trách mắng mình," một người dùng chia sẻ.

Theo Thạc sĩ Nguyễn Nam Anh, chuyên gia tâm lý tại Đại học California, Davis (Mỹ), đây là biểu hiện của hiện tượng tâm lý gọi là "ảo giác tin cậy" (trust hallucination). Con người có xu hướng tin vào những phản hồi trôi chảy, dễ hiểu mà bỏ qua việc xác minh nguồn gốc và độ chính xác của thông tin.

Để sử dụng AI một cách an toàn, các chuyên gia khuyến cáo người dùng cần tuân thủ các nguyên tắc sau:

Chỉ dùng để tham khảo thông tin cơ bản: Có thể hỏi AI về định nghĩa bệnh, các biện pháp phòng ngừa hoặc kiến thức y khoa phổ thông.

Tuyệt đối không dùng để tự chẩn đoán và kê đơn: AI không thể thay thế bác sĩ trong việc chẩn đoán và đưa ra phác đồ điều trị.

Bảo mật thông tin cá nhân: Hạn chế chia sẻ các dữ liệu sức khỏe nhạy cảm có thể tiết lộ danh tính lên các nền tảng AI công cộng.

AI đang được ứng dụng trong y tế chuyên nghiệp để hỗ trợ bác sĩ phân tích dữ liệu, hình ảnh lâm sàng, giúp chẩn đoán chính xác hơn, nhưng nó luôn đóng vai trò công cụ hỗ trợ, không phải người ra quyết định cuối cùng.

"Hỏi ChatGPT không có tội, nhưng tin hoàn toàn vào nó để chăm sóc sức khỏe thì lại là một câu chuyện khác. Sức khỏe không phải là nơi để mạo hiểm," anh Tuyên kết luận. Việc tìm đến các chuyên gia y tế vẫn là lựa chọn an toàn và đáng tin cậy nhất để bảo vệ điều quý giá nhất của con người.